最近の話題の過熱ぶりを見ると、まるで人工知能(AI)があらゆるところにすでに入り込んでいるかのようだ。だが現実には、AIを支える技術はまだ発展途上の段階にある。実際、多くのAIの応用事例では、AI用に設計されたチップではなく、汎用のCPUやゲーム用に設計されたGPUが使用されている。IBM、Intel、Googleなどの大手IT企業や、スタートアップやベンチャーキャピタルが、AIワークロード用の新しいチップの設計に慌ただしく投資しているのは、このミスマッチを解消するためだ。

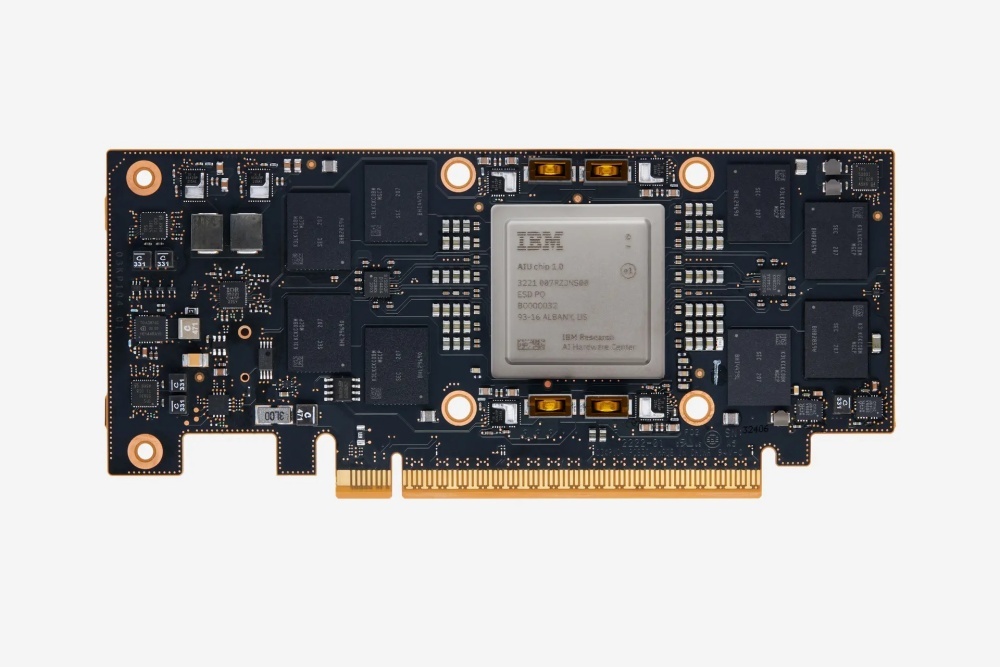

提供:IBM

この分野に対する企業の投資は、技術が向上するに従って確実に増えていくとみられている。Gartnerによれば、2021年のAIチップ市場の総売上高は340億ドル(約5兆円)以上に達しており、2026年には860億ドル(約13兆円)規模にまで拡大するという。さらに同社は、データセンターに置かれているサーバーのうちAIワークロード用のアクセラレーターを備えているのは、2020年時点で3%未満だったが、2026年には15%以上になると予想している。

このような状況の中、IBM Researchは、AIに特化したプロトタイプチップである「Artificial Intelligence Unit」(AIU)を発表した。

IBMは、AIUに関するプレスリリースで、「コンピューティングパワーは不足しつつある。これは、AIモデルの規模が指数関数的に大規模化している一方で、そうした巨大なモデルをトレーニングし、クラウドのサーバーやスマートフォンやセンサーなどのエッジデバイスで実行するためのハードウェアの進歩が、その勢いについて行けていないからだ」と述べている。

AIUは、IBM ResearchのAI Hardware Centerが開発した、エンタープライズAIの深層学習モデルの実行に特化して設計された、初めての完全なSoC(システムオンチップ)だ。

IBMは、「従来のコンピューティングの処理装置」(つまりCPU)は、深層学習が登場する前に設計されたものだと指摘している。CPUは汎用のアプリケーションには向いているが、超並列処理が必要な深層学習モデルのトレーニングや実装にはあまり向いていない。

IBM ResearchのAIコンピューティング担当ディレクターであるJeff Burns氏は、米ZDNetの取材に対して、「AIが今後、非常に長期間にわたって、ITソリューションの原動力となることは確実だ」と述べた。「AIは、コンピューティングを取り巻く環境や、こうした複雑な企業のITインフラやソリューションに、非常に広く拡散した形で浸透していくだろう」

Burns氏は、IBMにとって最も合理的なのは、普遍的に効果を発揮できる完全なソリューションを構築することであり、それができれば、「これらの機能をさまざまなコンピューティングプラットフォームに組み込み、企業のAIに対する非常に幅広い要求に対応することができる」と話した。

AIUは特定用途向けの集積回路(ASIC)ではあるが、あらゆる種類の深層学習タスクを実行できるようにプログラムできる。このチップには、5nmプロセスで製造された32個のプロセッシングコアが搭載されており、230億個のトランジスタが使われている。レイアウトはCPUよりも単純化されており、電力効率を高めるために、あるコンピューティングエンジンから次のエンジンへとデータを直接送れるように設計されている。また、グラフィックスカードとしても簡単に使用できる設計になっており、PCIeスロットを持っているあらゆるコンピューターやサーバーに搭載できる。

AIUでは、電力とリソースを節約するために、IBMが開発した、計算の精度を犠牲にして効率を向上させるための技術である近似計算(approximate computing)を使用している。これまで、計算には64ビット、あるいは32ビットの浮動小数点演算が使用されることが多く、金融や科学計算などをはじめとする高い精度が要求されるアプリケーションでの使用にも耐えられる精度を実現していた。しかし、大半のAIアプリケーションでは、そこまでの精度は必要とされていない。

「自動運転車の軌道について考えてみれば分かるが、車はレーンの中のどこか決まった位置にいなければならないわけではなく、レーン内で取れる位置には幅がある」とBurns氏は説明する。

ニューラルネットワークは、基本的に厳密なものではなく、結果は確率として出てくる。例えばコンピュータービジョンのシステムであれば、「見ているのが猫の写真である確からしさは98%」だと回答したりする。ところが初期のニューラルネットワークは、高精度演算でトレーニングされており、多くの電力と時間が消費されていた。

AIUに使用されている近似計算の技術は、32ビット浮動小数点演算を、4分の1の情報量しか持たない形式に落とし込むことができる。

IBMはまた、このチップの汎用性を実現するために、ハードウェア以外のイノベーションにも注目した。IBM Researchでは基盤モデルを非常に重視しており、400人から500人規模のチームで基盤モデルに取り組んでいる。特定のタスクのために作成されるAIモデルとは異なり、基盤モデルは、大量の多様なラベルなしデータをもとにトレーニングされ、巨大なデータベースに似たリソースを生み出す。その後、特定のタスクのためのモデルが必要になったら、比較的少量のラベル付きデータを使って基礎モデルを再トレーニングすることができる。

IBMは、このアプローチを用いてさまざまな業界やAIのユースケースに取り組んでいる。同社が基盤モデルを構築している領域はいくつかあり、化学や時系列データなどの分野のユースケースをカバーしている。時系列データとは一定時間ごとに収集されたデータのことだが、機器の状態を監視する必要がある工業分野の企業にとっては非常に重要だ。一旦いくつかの重要な分野の基盤モデルを構築してしまえば、その後は、より範囲を限定した、業界に特化した製品を開発することができる。また、AIUのソフトウェアには、IBMの子会社であるRed Hatのソフトウェアスタックとの完全な互換性が確保されているという。

Enjoyed this article? Sign up for our newsletter to receive regular insights and stay connected.